月之暗面开源Kimi K2.5多模态大模型:支持图像/视频理解、Agent集群与前端代码自动生成

SmartHey1月27日消息,月之暗面今日正式发布并开源其最新多模态大模型——Kimi K2.5。同步上线的还有Kimi智能助手K2.5版本,用户访问官网聊天界面时,系统已默认将原K2模型无缝升级为K2.5。

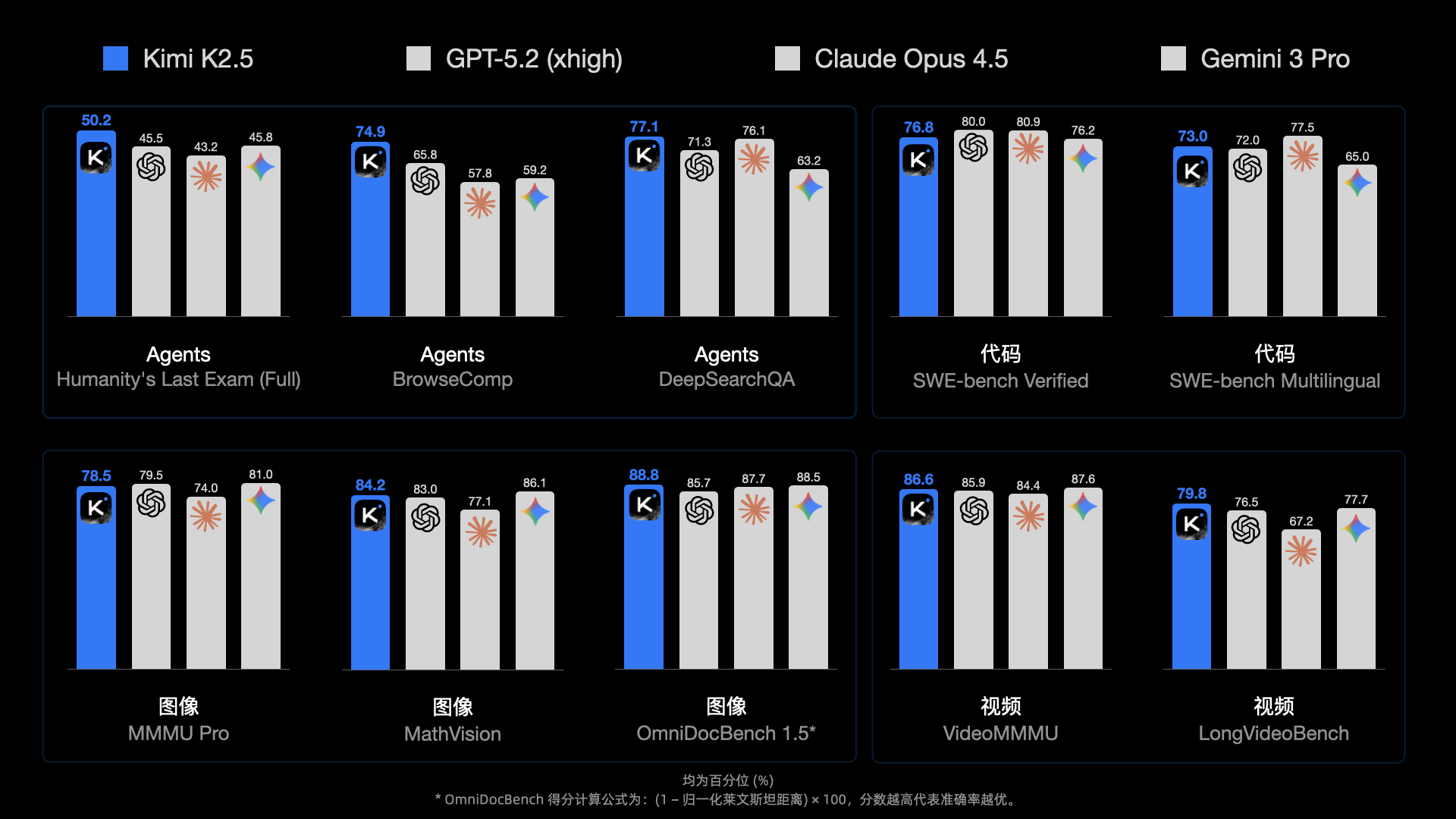

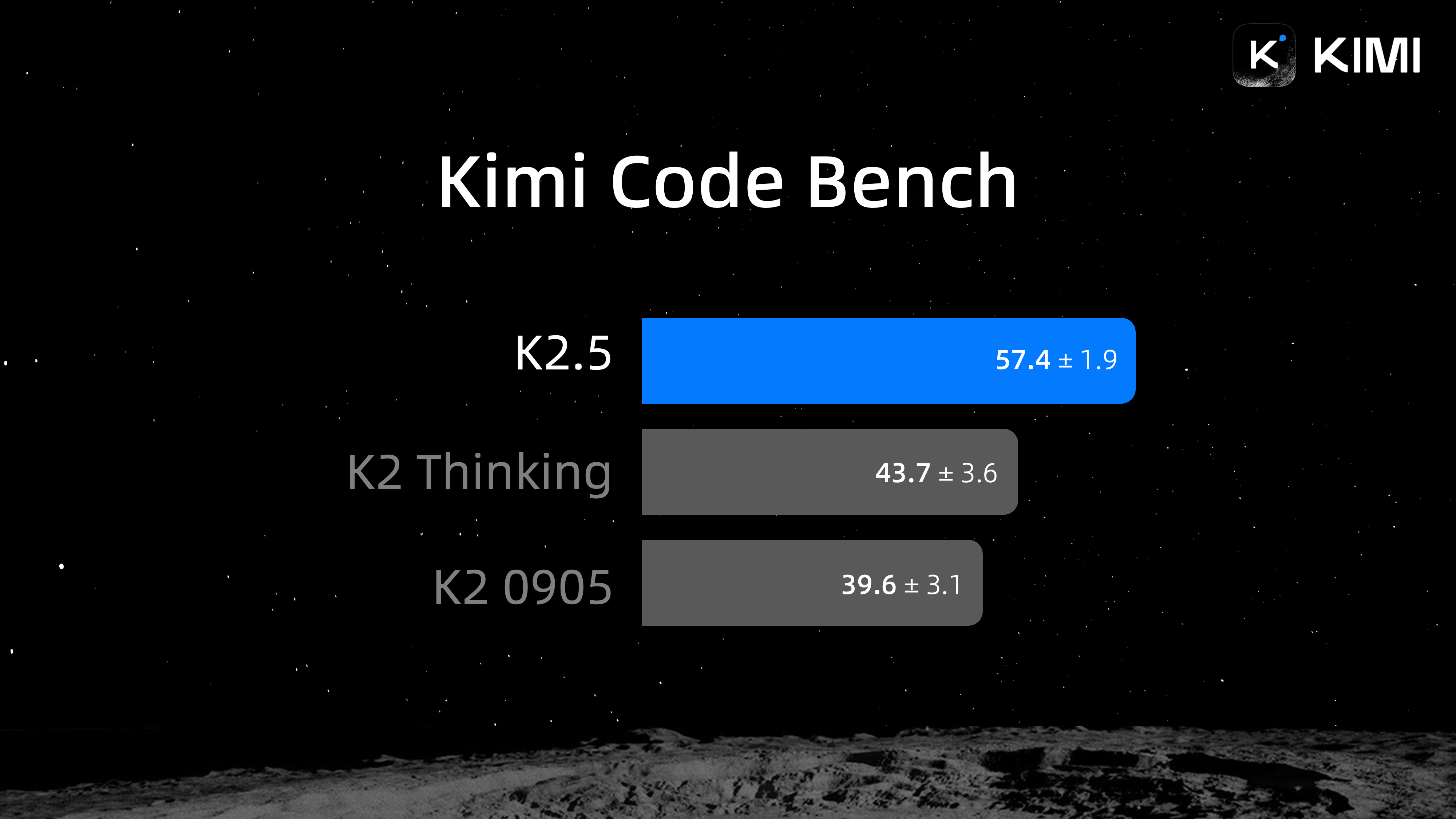

Kimi K2.5是目前月之暗面最先进、最全能的开源模型,在Agent能力、代码生成、视觉理解、视频分析及通用智能任务上均达到开源领域SOTA(state-of-the-art)水平。该模型采用原生多模态架构,原生支持文本+图像双输入,兼容‘思考模式’与‘非思考模式’,并可灵活切换对话交互、复杂推理与自主Agent任务等多重工作范式。

作为一款通用型多模态基础模型,Kimi K2.5被定位为‘一模型多场景’的核心引擎,可在自然语言对话、深度逻辑推理与端到端自动化任务之间动态适配、自由切换。

在视觉理解能力方面,K2.5实现显著跃升:用户不再仅限于文字描述,还可直接上传图片、截图或录屏片段,由模型完成语义解析、结构识别与行为推断。该能力已落地于界面操作辅助、文档版式还原、交互流程反向建模等实际场景。

在编程与软件工程方向,K2.5延续并强化了K2系列在前端开发领域的优势,支持通过视觉输入(如UI截图、操作录屏)理解交互意图,并精准复现对应代码逻辑。

官方演示显示,模型可基于自然语言指令生成具备响应式布局、滚动触发、动画过渡等完整交互功能的前端页面代码;更进一步,它能对用户提供的界面操作录屏进行帧级拆解,识别控件状态变化与事件流路径,并输出结构化、可运行的实现方案。该能力已在视频动作识别、教育交互分析等API内测场景中完成验证。

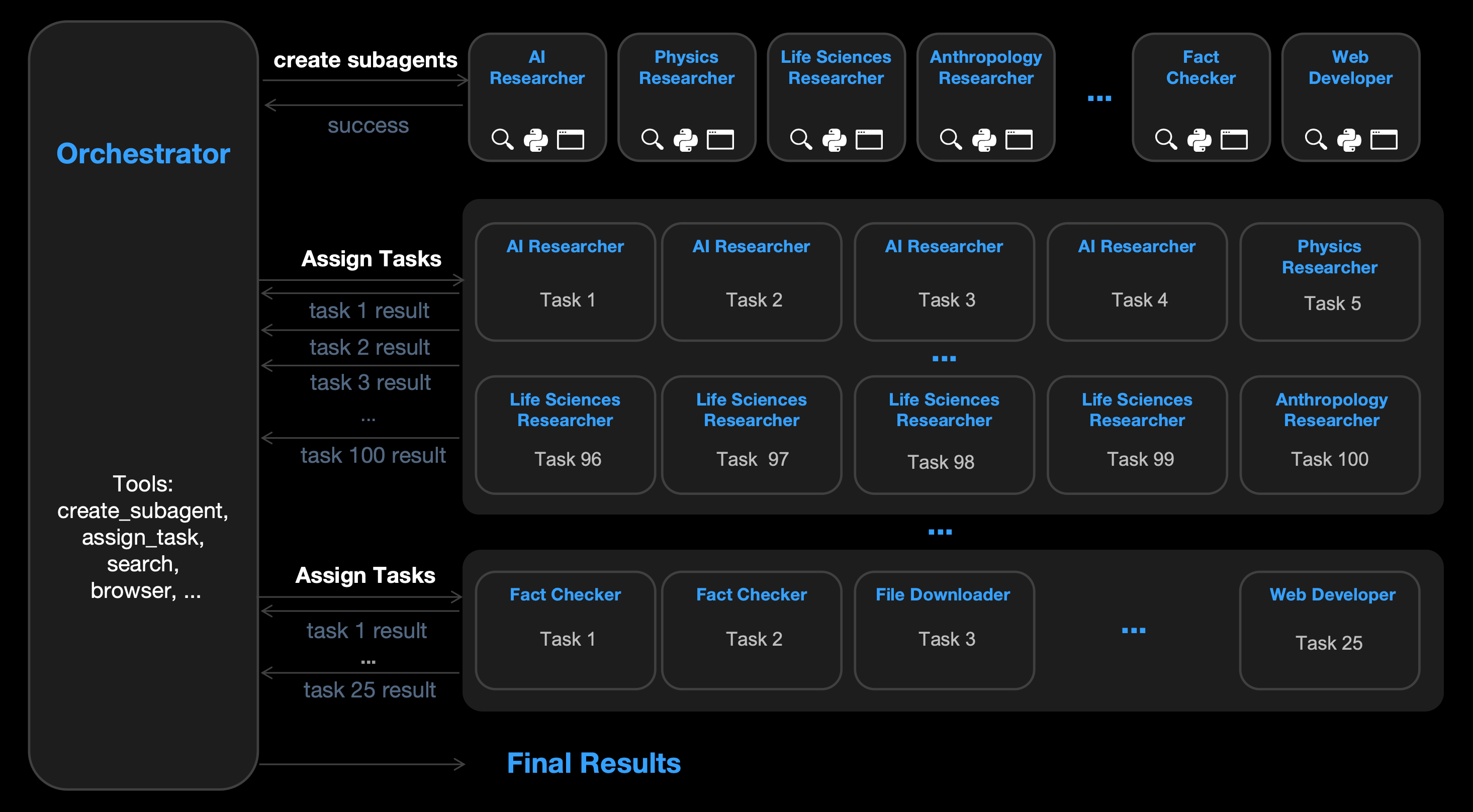

除单体Agent能力外,K2.5首次引入创新性‘Agent集群’机制——面对复杂任务时,模型可自主规划、动态生成多个专业化子Agent,并行执行不同子模块,大幅提升任务分解粒度与执行鲁棒性。

据官方介绍,Agent集群最多可协同调度上百个子Agent,支持超千步的任务流程编排。所有角色定义、分工策略与依赖关系均由模型在运行时实时推演生成,无需人工预设任务图谱。在学术研究场景中,该机制已成功应用于多篇论文的通读分析、分段撰写与结构化汇编,最终输出逻辑严密、格式规范的长篇技术文档。

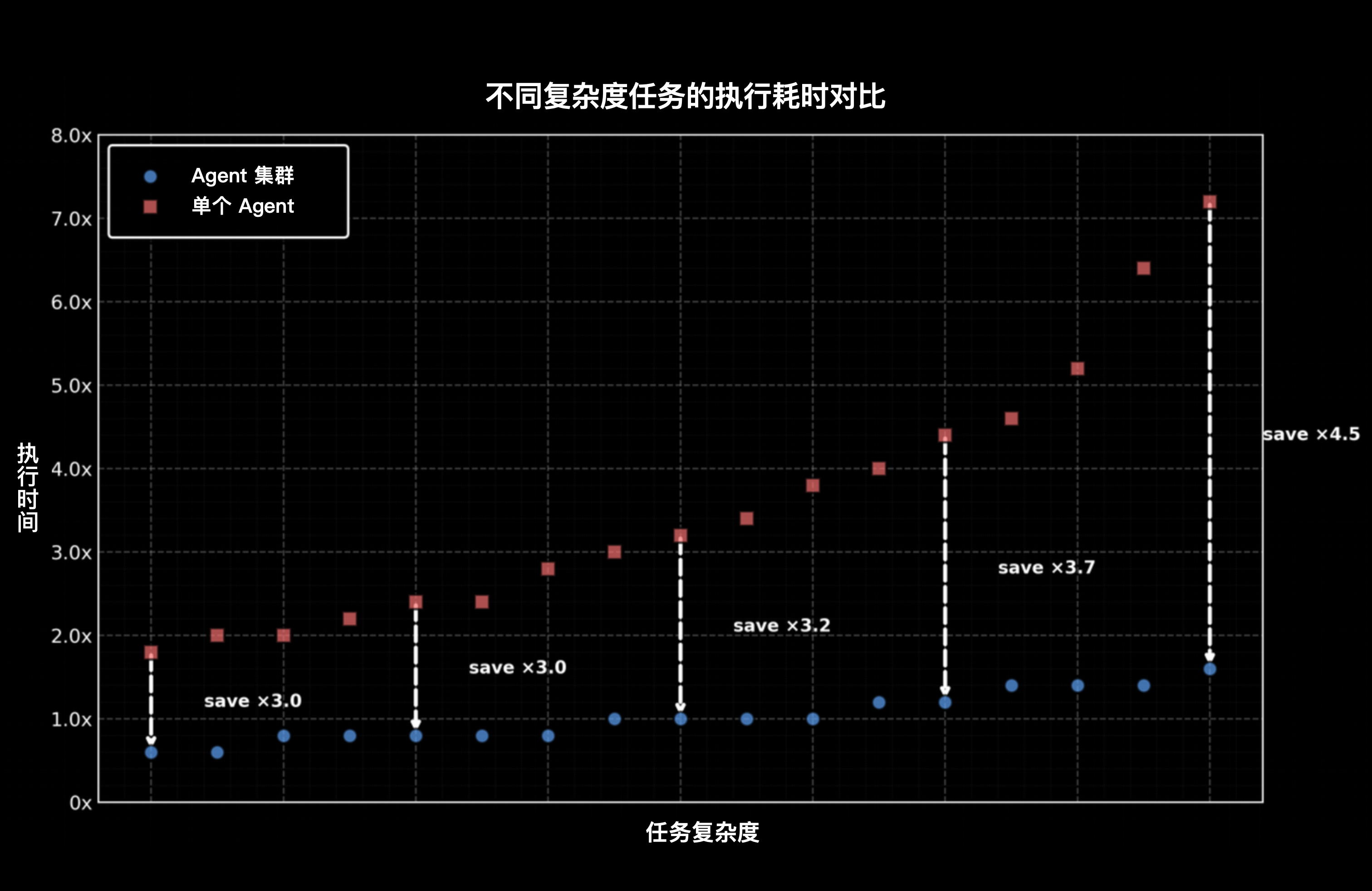

性能实测表明,在大规模信息检索与复合型任务中,Agent集群相较传统单Agent方案,关键步骤数平均减少约37%,整体执行耗时下降超28%。为支撑该能力,研发团队全面重构了强化学习训练框架与分布式调度算法。当前Agent集群功能处于Beta测试阶段,将按计划逐步向开发者与企业用户开放。

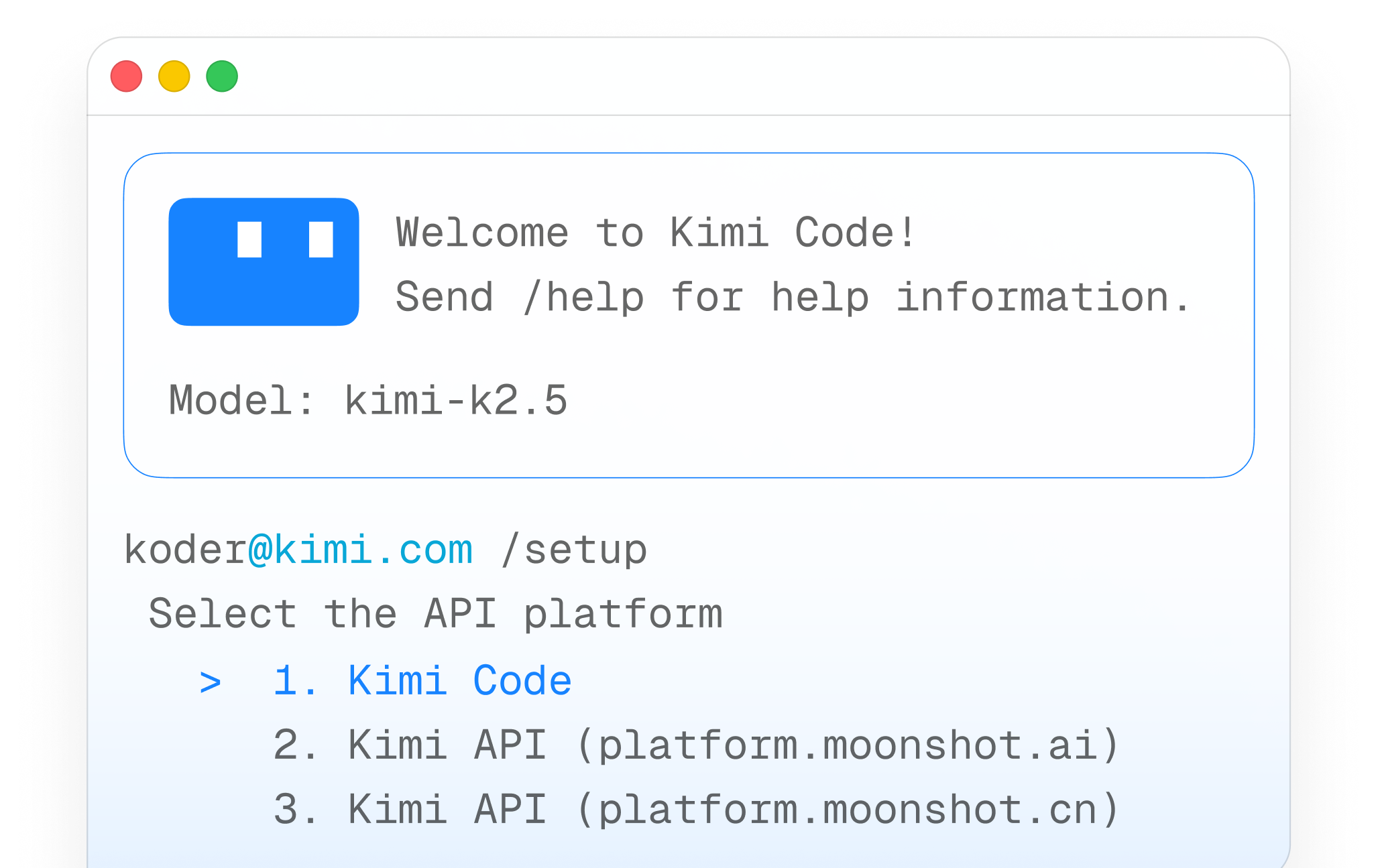

随K2.5模型同步发布的还有面向开发者的编程工具——Kimi Code。该命令行工具轻量高效,原生支持VS Code、Cursor、JetBrains全系IDE(IntelliJ、PyCharm等)及新兴编辑器Zed,助力AI编程能力深度融入日常开发流。

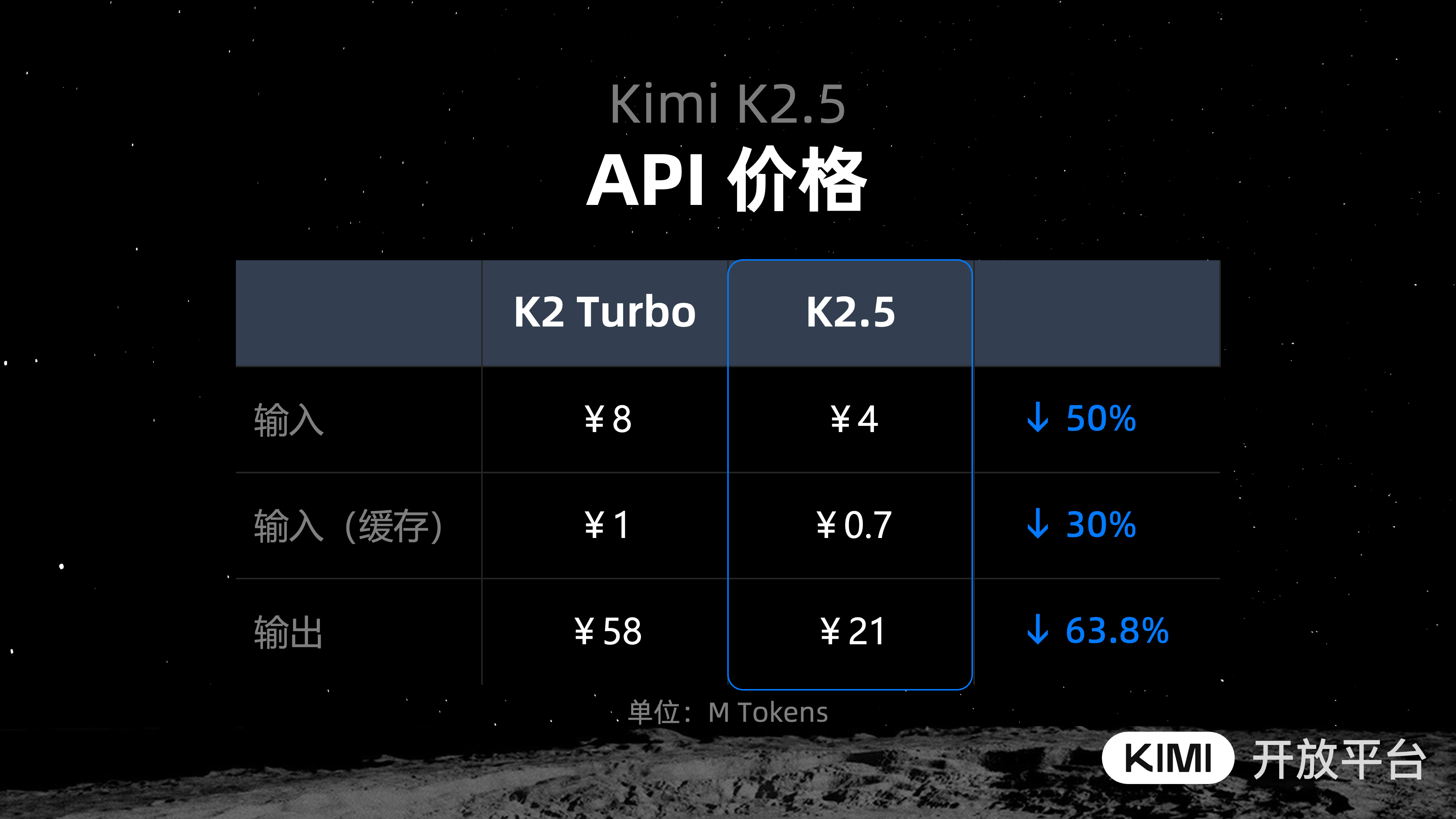

目前,Kimi K2.5模型已全面上线Kimi官网、移动端App及API开放平台。普通用户可通过网页/APP免费体验多种交互模式;开发者与企业客户亦可调用标准化API,快速集成至自有产品与业务系统中。