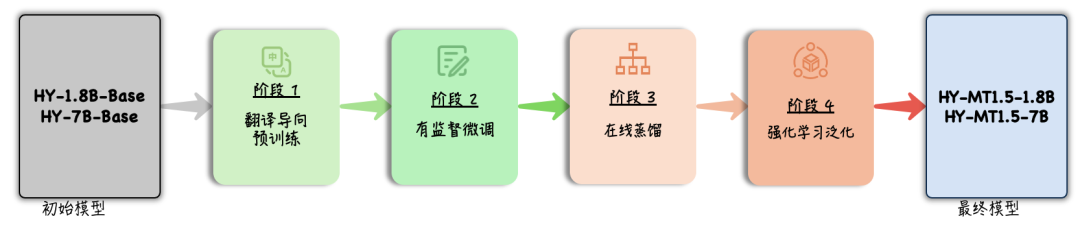

腾讯混元开源翻译模型 1.5:手机 1GB 内存即可运行,效果超越商用 API

SmartHey12月30日消息,腾讯混元今日宣布开源翻译模型 1.5 版本,共推出两款模型:Tencent-HY-MT1.5-1.8B 和 Tencent-HY-MT1.5-7B,支持33个语种互译以及5种民汉/方言翻译。除中文、英语、日语等常用语言外,还涵盖捷克语、马拉地语、爱沙尼亚语、冰岛语等小语种,进一步拓展多语言服务能力。

目前,这两款模型均已上线腾讯混元官网,并同步在 Github 和 Huggingface 等主流开源社区开放下载,供开发者自由使用。

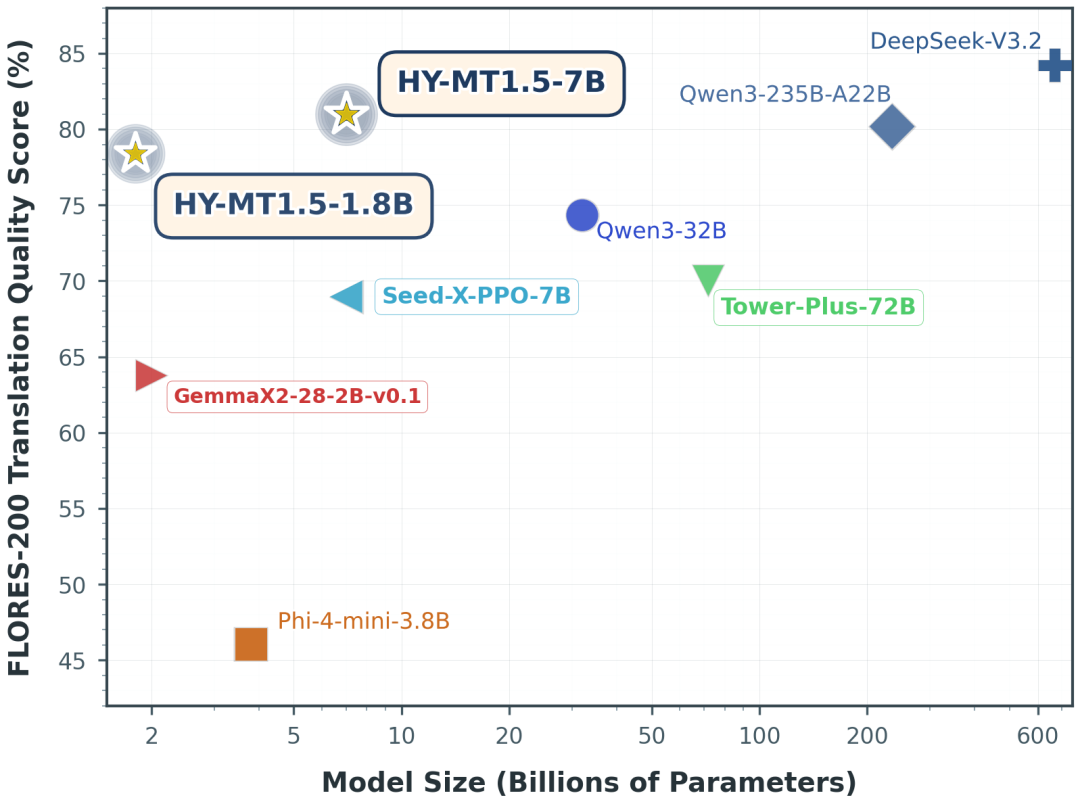

其中,HY-MT1.5-1.8B 模型专为手机等消费级设备优化设计,经过量化处理,可在端侧实现离线实时翻译,仅需1GB内存即可流畅运行。官方表示,在极小参数量下,其翻译效果已超越多数商用翻译API。

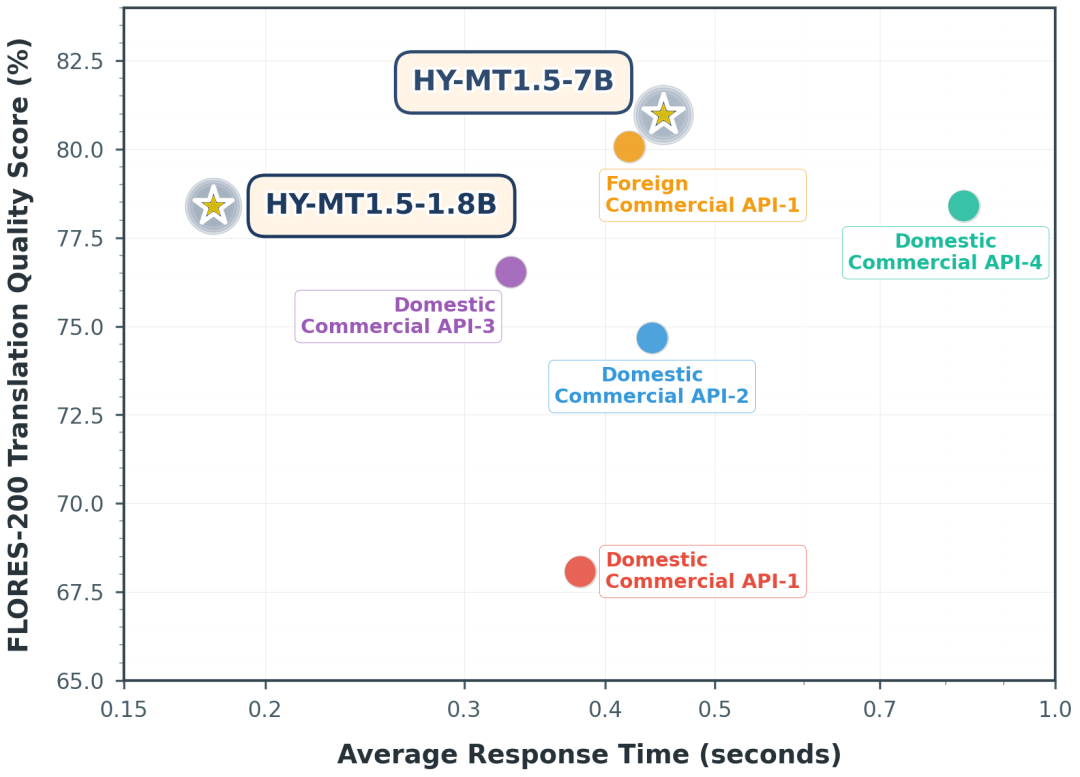

在推理速度方面,HY-MT1.5-1.8B 同样表现优异,处理50个tokens的平均耗时仅为0.18秒,显著快于其他主流模型约0.4秒的平均水平,更适合高并发、低延迟的应用场景。

HY-MT1.5-7B 模型则在前代基础上实现显著提升,是此前斩获 WMT25 多语种翻译竞赛30项冠军模型的升级版本。新版本重点优化了翻译准确率,大幅减少译文中出现注释残留和语种混杂的问题,整体实用性更强。

在实际应用中,用户可结合使用混元翻译的1.8B与7B两种尺寸模型,实现端侧与云侧协同部署,从而提升翻译结果的一致性与系统稳定性。

在 Flores200、WMT25 及民汉语言测试集上的评估显示,Tencent-HY-MT1.5-1.8B 在多项指标上全面优于中等规模开源模型及主流商用翻译API,性能达到超大规模闭源模型 Gemini-3.0-Pro 的90分位水平;在WMT25与民汉翻译任务中,其表现虽略逊于Gemini-3.0-Pro,但仍远超其他同类模型。

在FLORES-200质量评测中,HY-MT1.5-1.8B取得了约78%的得分,同时保持平均0.18秒的响应速度,优于当前主流商用翻译API,适用于即时通讯、智能客服、移动翻译等对实时性和吞吐量要求较高的场景。

此外,两款模型均增强了对多种复杂场景的支持能力,覆盖术语管理、长上下文理解与带格式文本翻译:

首先是术语支持。腾讯混元翻译模型1.5具备自定义术语库功能,用户可根据医学、法律、金融、科技等行业需求,预先构建专属术语对照表,确保关键术语在翻译过程中高度一致且准确。

通过简单配置导入术语库后,模型将在翻译时优先采用用户设定的标准词汇,有效提升专业文档、技术手册、合同文本等内容的翻译权威性与可靠性。

其次是上下文理解能力。模型支持长文本与多轮对话上下文建模,能够基于历史语境持续优化后续翻译输出,增强在会议记录、访谈稿、小说章节或技术文档等连续内容中的连贯性与逻辑一致性。

无论是多轮问答还是长篇段落,模型均可精准捕捉指代关系与风格特征,避免语义断裂或表达不统一的问题。

第三是带格式文本翻译。依托强大的指令遵循能力,混元翻译模型可在翻译过程中保留原始格式信息(如网页结构、标点排版等),确保输出结果既准确又实用。

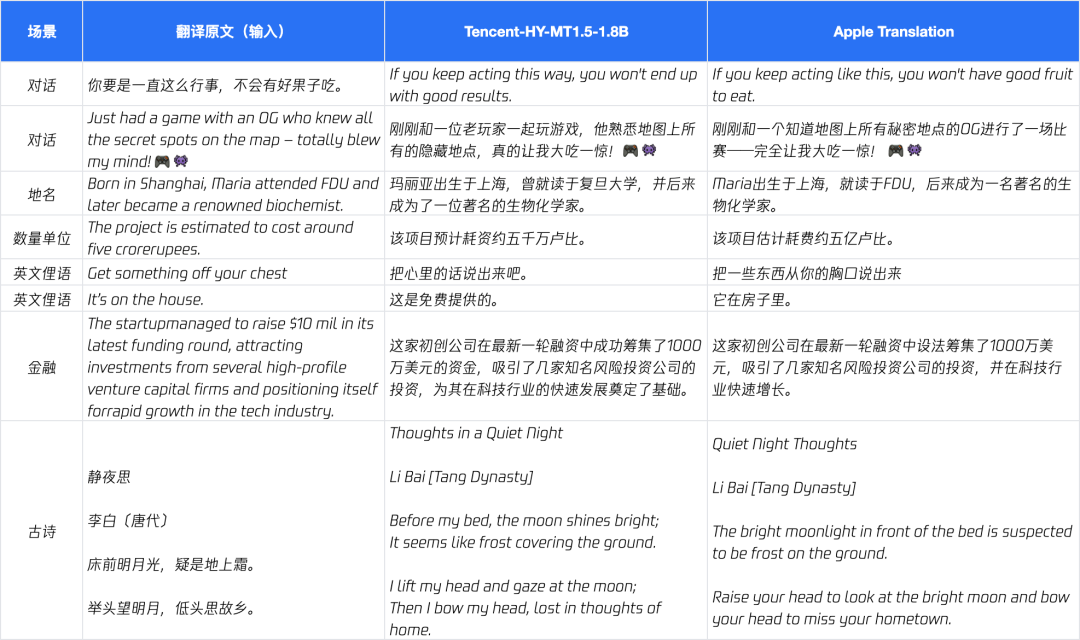

为直观展示 HY-MT1.5-1.8B 的实际效果,官方还发布了其与苹果手机自带离线翻译功能的对比示例:

技术层面,HY-MT1.5-1.8B 能以较小体积实现接近大模型的效果,关键在于引入了 On-Policy Distillation(策略内蒸馏)方法。该方法以 HY-MT1.5-7B 作为教师模型(Teacher),实时指导1.8B学生模型(Student)学习序列预测分布,避免机械记忆标准答案,转而通过纠正偏差实现从错误中学习,显著提升小模型的语言理解与生成能力。

此前,腾讯混元翻译模型已在国际机器翻译赛事中夺得30项第一,首次开源一周即登上HuggingFace模型趋势榜首位。目前,该系列模型已在腾讯内部广泛落地,应用于腾讯会议、企业微信、QQ浏览器、客服系统等多个业务场景。

为方便开发者快速集成与部署,本次开源模型已全面适配 Arm、高通、Intel、沐曦等多种硬件平台,可在 GitHub 与 Huggingface 直接获取。