DeepSeek-V4正式开源,昇腾950成国产AI算力新支点:从“能用”迈向“好用”

撰文 | 雁 秋

编辑 | 李信马

题图 | 豆包AI

AI圈翘首以盼的DeepSeek-V4,终于来了!

自2025年初发布V3以来,DeepSeek陆续推出V3.1、V3.2-Exp等迭代版本,但性能提升有限,未引发显著关注。

直到4月24日,DeepSeek正式开源V4预览版,并同步发布两大商用版本:V4-Pro与V4-Flash。

V4-Pro:总参数量达1.6万亿,单次推理激活约490亿参数,定位旗舰级模型,对标国际顶级闭源大模型。

V4-Flash:总参数量2840亿,激活参数约130亿,主打高性价比与低延迟,适用于轻量级场景与高频调用。

图源:DeepSeek官网

V4系列发布后,“源神”话题迅速登顶科技热榜;华丰科技、寒武纪、摩尔线程、中芯国际等相关概念股应声大涨。

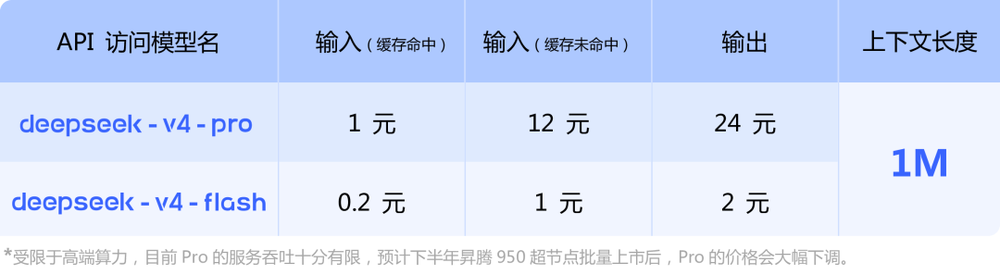

官方同步公布API定价策略:

V4-Pro:输入命中缓存时为1元/百万tokens,未命中缓存为12元/百万tokens,输出统一为24元/百万tokens;

V4-Flash:输入命中缓存仅需0.2元/百万tokens,未命中为1元/百万tokens,输出为2元/百万tokens。

图源:DeepSeek官网

值得注意的是,V4-Pro当前服务吞吐能力受限。DeepSeek明确表示:V4-Pro初期供应紧张,预计下半年随着昇腾950超节点批量上市,价格将大幅下调。

一句“下半年批量上国产算力”,折射出以昇腾950为核心的国产AI算力生态正加速演进——从技术“备选”升级为产业“刚需”,成为重构中国大模型成本结构的关键变量。

此前DeepSeek训练高度依赖英伟达GPU,但在美国持续加码对华高端芯片出口管制背景下,构建自主可控的AI算力底座已成战略必然。

值得关注的是,V4技术报告第3.1节首次明确指出:“我们在英伟达GPU和华为昇腾NPU两个平台上均验证了细粒度专家并行(EP)方案。”

这是DeepSeek首次在正式技术文档中,将昇腾NPU与英伟达GPU并列纳入硬件适配清单。业内分析认为,虽然部分训练任务仍基于英伟达平台完成,但DeepSeek对昇腾的适配已实现深度原生化,达到前所未有的工程成熟度。

IDC最新数据显示,2025年国产GPU与AI芯片厂商市场份额已达41%,总出货量约400万张。其中,昇腾出货量居首,占比近半;阿里平头哥紧随其后;百度昆仑芯与寒武纪并列第三;海光信息、沐曦、天数智芯等第二梯队厂商亦稳步放量。

顶尖大模型加速适配国产算力,软硬协同生态雏形初现。

01、抓住算力主权:从“替代”到“自主”的跃迁

昇腾与英伟达虽路径相似,但底层逻辑迥异:前者坚持全栈自研NPU架构与CANN软件栈,覆盖运行时、驱动、虚拟指令集及编译器等全部核心环节;后者依托GPU+CUDA生态。这一选择,旨在从根本上摆脱对CUDA生态的技术依附。

昇腾的自我革新始于芯片架构。早期产品在算力配比、编程灵活性、访存粒度、低精度支持等方面存在短板。经过多轮迭代,2026年3月华为合作伙伴大会揭晓成果:

搭载昇腾950PR的Atlas 350加速卡,单卡FP4算力达1.56P,为英伟达H20的2.87倍;HBM内存容量112GB,较H20提升16%;内存访问粒度压缩至128字节,小算子访存效率提升4倍。

更关键的是,昇腾率先实现国内首个真正商用的FP8精度支持——在智能体爆发、Token处理量激增的当下,可显著降低单位算力开销。

据悉,2025年DeepSeek基于英伟达平台实现FP8创新时,昇腾团队曾因外部限制未能同步跟进。而今,市场对昇腾950的接受速度远超预期。

需客观看待的是,950在特定场景下单卡推理性能约为H20的3倍,但整体旗舰级能力仍与英伟达存在代际差距。对此,昇腾方面回应明确:坚持通用型路线,每一代芯片聚焦确定性改进方向,而非盲目追求全面赶超。

客户反馈印证进展:从试用到下单周期由一两个月缩短至一周。“过完年就售罄的产能,正在全力爬坡。”据内部人士透露,“有客户专程赴深圳签单,动辄千万卡起订。”尽管如此,团队仍保持清醒:“950并不完美,还有很多事要做。”

一个正向飞轮已然形成:国产算力规模扩大→单位成本下降→模型服务价格走低→开发者采用意愿提升→算力需求进一步增长。

当这一循环稳固运转,昇腾将不再只是“可用”的国产替代,而是凭借真实竞争力成为支撑中国AI独立发展的核心加速引擎。

02、生态重构:把“麻花团”拆开,让开发者真正留下来

过去,昇腾CANN生态被内部称为“麻花团”:软件模块高度耦合,一次升级牵动全局,极大影响开发体验。

昇腾的破局之道是:底层全自研,上层全兼容;架构解耦,模块开源;目标只有一个——让开发者“来了就不想走,更愿意一起共建”。

要赢得全球主流开源项目(90余个以海外团队为主导)的认可,远非技术公告所能达成。昇腾团队选择深入社区一线,用代码说话、用实测证明——主动参与PyTorch、Hugging Face等关键项目适配,提供原生NPU支持。

他们甚至做了件“自我革命”的事:重写整套软件栈,完成架构解耦与模块化重构,使每个组件均可独立更新、独立开源。为保障开发者“不换门、不折腾”,昇腾全力推动生态兼容,允许用户按需替换或优化任意模块。

原计划一年半的架构重构,最终仅用四个月完成。开源仓库数量从20余个增至70多个,高校与伙伴项目持续涌入。社区治理强调开放性:技术指导委员会外部成员占比不低于50%,每月例会已召开200余场,规则共商、道路共拓。

开发者是生态活力之源。目前昇腾已有1.3万底层算子开发者,与英伟达同领域规模持平;月活跃开发者超2000人,高于PyTorch社区(900+),在偏底层的硬核项目中尤为难得。

对于如何吸引习惯CUDA的开发者,昇腾态度务实:“没有捷径,只看谁做得更好、对开发者更有价值。哪个平台更能满足你的需求,你就选哪个。”

昇腾内部笃信:“客户的成功,才是华为的成功。”支持客户在竞争中胜出,才能赢得长期信任。“客户转了一圈回来说‘还是你们最好’,就是最硬的口碑。”在AI这个标准缺失、节奏飞快的赛道,拼的是第一时间适配新模型、快速响应安全需求的能力。

“生态本质是‘量’的问题。没有销量和用量,谈生态就是空中楼阁。”一位昇腾负责人直言,“我把外部开发者视为‘不要钱的员工’,让他们真正成为生态体系的一分子。”据悉,团队已设立2000万元专项激励资金,“希望开发者们尽快花完,这个季度用完,下个季度再发2000万。”

未来趋势清晰可见:上层框架与主流开源项目将越来越多地以昇腾为原生支持平台。“这是我们的目标——维持95%以上兼容率,同时不断扩大分母中的‘昇腾成分’。”

尾声

DeepSeek-V4发布稿末尾引用《荀子·非十二子》:“不诱于誉,不恐于诽,率道而行,端然正己。”意为不为虚名所惑,不因非议所惧,坚守正道,持身端正。

这一定力,在AI浪潮汹涌的当下尤为珍贵。从ChatGPT引爆全球,到DeepSeek惊艳亮相,再到2026年初智能体(Agent)爆发,每一次技术跃迁都裹挟着“泼天富贵”的喧嚣。

但热潮也易掩盖本质问题。昇腾也曾走过弯路,也曾被短期红利模糊焦点。真正的突破,在于从喧嚣中识别真需求,在制约中锚定根本——芯片自主与生态扎根。

拒绝在软件层简单复刻CUDA,因为那终将沦为为他人生态“添砖加瓦”。唯有全栈自研、开放共建,方能在极端情况下守住技术底线。

回望来路,昇腾的节奏不算最快,却足够扎实。这恰如荀子所倡:不争一时之誉,唯求一事之正——专注于做正确的事,而非活在他人评价之中。